Web Culture

Προβλήματα στην Αξιολόγηση των AI από Μεγάλες Εταιρείες

Οι ερευνητές αποκαλύπτουν προβλήματα στην αξιολόγηση AI από μεγάλες εταιρείες, υπογραμμίζοντας την ανάγκη για διαφάνεια και βελτιώσεις.

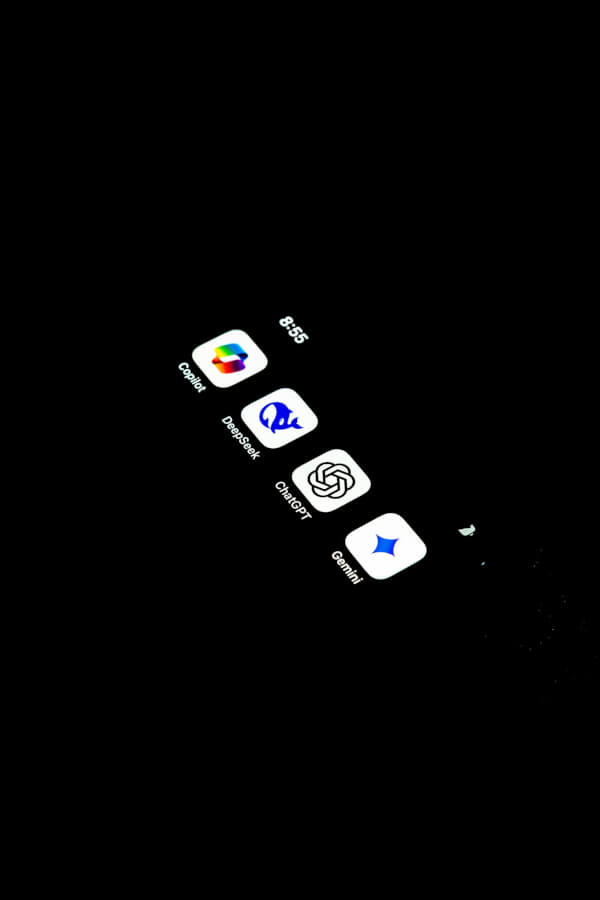

Η πιο διαδεδομένη μέθοδος αξιολόγησης των κορυφαίων chatbots παγκοσμίως φαίνεται να είναι ελαττωματική και συχνά χειραγωγείται από μεγάλες εταιρείες όπως η OpenAI και η Google, σύμφωνα με μια νέα μελέτη από ερευνητές της εταιρείας Cohere, καθώς και από πανεπιστήμια όπως το Stanford και το MIT. Οι ερευνητές κατέληξαν σε αυτό το συμπέρασμα αφού εξέτασαν δεδομένα από το Chatbot Arena, το οποίο διευκολύνει την αξιολόγηση και διατηρεί τον πίνακα κατάταξης των καλύτερων μεγάλων γλωσσικών μοντέλων (LLMs).

Αντιδράσεις και Κατηγορίες

Το Chatbot Arena απάντησε στις κατηγορίες των ερευνητών, αναγνωρίζοντας ορισμένες κριτικές και σχεδιάζοντας να τις αντιμετωπίσει, αν και υποστηρίζει ότι ορισμένα από τα στοιχεία που παρουσίασαν οι ερευνητές είναι λανθασμένα. Η έρευνα δημοσιεύθηκε λίγο μετά από κατηγορίες προς τη Meta για χειραγώγηση των benchmarks με ένα από τα πρόσφατα μοντέλα της.

Η Σημασία της Κατάταξης

Η διαμάχη αυτή έχει σημασία, καθώς οι μεγαλύτερες τεχνολογικές εταιρείες, καθώς και πολλές μικρότερες startups, βρίσκονται σε έντονο ανταγωνισμό για την ανάπτυξη των πιο προηγμένων εργαλείων AI. Ο στόχος είναι να καθορίσουν το μέλλον της ανθρωπότητας και να πλουτίσουν με τρόπο που οι προηγούμενες τεχνολογικές εκρήξεις φαίνονται μικρές συγκριτικά.

Η Μέθοδος Αξιολόγησης

Η αξιολόγηση των μεγάλων γλωσσικών μοντέλων είναι περίπλοκη, καθώς διαφορετικοί χρήστες χρησιμοποιούν διαφορετικά μοντέλα AI για διαφορετικούς σκοπούς. Η επιθυμία να συγκριθούν αυτά τα μοντέλα οδήγησε τη βιομηχανία AI στην πρακτική της αξιολόγησης μέσω benchmarks. Το Chatbot Arena δίνει έναν αριθμητικό “Arena Score” στα μοντέλα που υποβάλλονται και διατηρεί έναν πίνακα κατάταξης με τα υψηλότερα σκορ.

Κριτική και Προτάσεις

Οι ερευνητές επισημαίνουν ότι το Chatbot Arena επιτρέπει στις μεγάλες εταιρείες να διεξάγουν “κρυφές ιδιωτικές δοκιμές” και να επιλέγουν το καλύτερο μοντέλο τους. Η ανάλυση τους περιέλαβε δεδομένα από 2 εκατομμύρια “μάχες” και 243 μοντέλα. Το Chatbot Arena απαντά ότι η πολιτική του σχεδιάστηκε για να αποτρέπει την αναφορά μόνο του υψηλότερου σκορ που επιτυγχάνεται κατά τις δοκιμές.

Παρά την κριτική, οι ερευνητές αναγνωρίζουν τη συμβολή του Chatbot Arena στην έρευνα AI και προτείνουν βελτιώσεις, όπως η αποτροπή απόσυρσης σκορ μετά την υποβολή και μεγαλύτερη διαφάνεια στις ιδιωτικές δοκιμές.